Sommaire

- EU Annex 1 draft : Propositions du GIC A3P Annexe 1.

- Data Integrity : vers la mise en place d'un Data Management.

- Le Lien entre réglementation, système qualité & Data Integrity.

- Migration dans le Cloud & Data Integrity.

- Incidences du calcul de la PDE en tant que limite d'exposition pour l'analyse de risques dans des installations partagées.

- L'IVDR signale la refonte de l'industrie de diagnostic in vitro.

- Tungsten in the production of prefillable syringes. Also possible without tungsten.

L’émergence des nouveaux textes sur l’intégrité des données (Data Integrity), et l’interprétation qui en est faite au travers d’audits et d’inspections, n’occulte en rien les éléments préexistants de la réglementation et particulièrement l’Annexe 11 des EU-GMP.

Comme précisé il ne s’agit pas à proprement parlé d’une nouvelle réglementation, mais plutôt d'”… une nouvelle approche dans la gestion et le contrôle des données…” Cette nouvelle orientation permet de mettre en avant des aspects déjà évoqués dans les textes existants et de rappeler que les pratiques ont fait l’objet d’écarts soit du fait d’une mauvaise application de la réglementation, soit parfois de faits délibérément délictueux.

Si le périmètre de l’intégrité des données est censé recouvrir toutes les données, quel que soit leur nature, nous traiterons plus particulièrement ici des données dans leur nature électronique, et surtout des données comprises et manipulées par les systèmes d’informations.

Le caractère novateur des textes relatifs à l’intégrité des données relève donc aussi bien d’une prise de conscience que d’une nouvelle façon d’entrevoir la responsabilité des entreprises. Nous montrerons en quoi les concepts peuvent parfois reprendre des points déjà largement évoqués dans les textes pre-existants, et particulièrement l’Annexe 11 des EU-GMP(5), et en quoi, certaines positions apportent un éclairage tout particulier. Nous examinerons également l’impact de la mise en œuvre de la Data Integrity, sur le système qualité existant et les évolutions qu’il est nécessaire d’envisager pour y répondre.

Mais avant tout, nous identifierons ce qui relève de nouveaux éclairages ou de sujets déjà largement débattus.

1. Les grands principes de l’Intégrité des Données

Le concept général commence à être maintenant bien connu notamment au travers de l’acronyme ALCOA(2 – § III 1. A) ou de sa version étendue (voir ALCOA+). L’explication détaillée et commentée de chacune des lettres est suffisamment documentée aussi nous nous accorderons plutôt à identifier les concepts nouveaux.

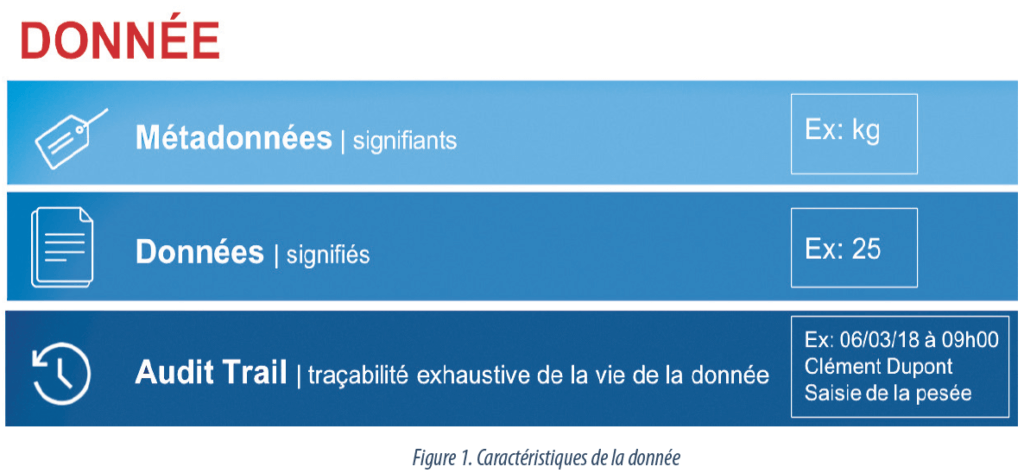

1.1 Data, Méta-Data, Trail, Static-Dynamic

Au travers de l’intégrité des données, on constate que leur vision devient plus globale. La donnée n’est pas une et autonome. Toute donnée signifiée dépend d’autres signifiantes. Ainsi, un poids par exemple, n’est qu’un chiffre mais qui n’a aucune valeur sans que les métadonnées qui signifient son unité, ne sont pas accolées. Le concept de données évolu, la donnée n’est plus uniquement le signifié, mais l’ensemble des données qui le compose. Cette donnée peut aussi, selon les circonstances évoluer. L’historique d’évolution de cette donnée, ainsi que les différents états successifs, sont aussi indissociables. Dès lors, il faut réviser notre concept de données pour considérer que la donnée est alors l’ensemble du signifié, des métadonnées qui constituent les signifiants et des historiques et audit-trail qui y sont associés. L’ensemble devient indissociable et devient la donnée. On comprend aussi, qu’en fonction de la nature des données, certaines d’entre elles restent immuables après leur création en relation avec leur support (on parle de données statiques comme par exemple les données “papier”) et d’autres peuvent interagir avec l’utilisateur (données dites dynamiques comme les données électroniques) qui peut éventuellement les retraiter en vue d’une meilleure exploitation.

Ces trois notions, dont l’association indestructible représente une nouvelle vision, sont bien mises en avant dans les textes qu’il s’agisse du document de la FDA (2 – III – 1 – b,c et d), du guide du PIC/S (3 – 7.5, 8.11.2) ou du document du MHRA, qui de façon plus nette qualifie de donnée statique un document au format papier et de dynamique un enregistrement au format électronique (4 – 6.3, 6.7, 6.13).

Cette intrication (voir Fig.1) définie une nouvelle unité qui est alors La Donnée.

1.2 Gouvernance et comportement

Un autre point majeur apparaît rapidement à la lecture des textes, c’est celui de l’implication souhaitée au plus haut niveau de l’organisation (“Highest levels or organisation” 4 – § 3.3, ou “Senior Management should be accountable” 4 – § 6.5) de la prise en charge du sujet de l’Intégrité des données. Il est demandé que cette prise en charge soit de la responsabilité de la direction, mais aussi que des cycles de formation et des procédures soient réalisées dans ce sens. Un focus tout particulier est apporté autour du comportement (Behaviour) du personnel et des managers pour la gestion de l’intégrité de données. Le guide PIC/s établit même une forme de catégorisation en fonction de l’attitude de l’entreprise en matière de comportement des collaborateurs vis-à-vis des problématiques de l’intégrité des données. L’entreprise présente-t-elle une culture “Open” c’est-à-dire où l’ensemble des collaborateurs, jusqu’aux employés peut challenger la hiérarchie dans le sens de la meilleure protection des données, à l’opposée d’une entreprise qui présenterait une culture “Closed” c’est-à-dire où il est culturellement plus difficile de remettre en cause le management ou le reporting des anomalies. Ceci afin de s’assurer qu’au sein de l’entreprise “Open“, les collaborateurs sauront échapper à toutes formes de pressions en provenance de la hiérarchie qui seraient contraires aux exigences de l’intégrité des données.

On comprend que les auteurs de ces documents s’attendent à ce que les différentes organisations engagent des plans d’actions au plus haut niveau pour un vrai programme de gestion de l’intégrité des données, avec une politique d’entreprise établie (rédigée sous forme d’une Policy ou d’une Procédure à plus haut niveau), que des sponsors dans le management soient désignés, qu’un véritable projet de mise en place soit réalisé, que des formations soient effectuées auprès de tous les collaborateurs pour sensibilisation et implication et que des revues périodiques avec des éventuels actions correctives et préventives (CAPA) soient mises en place.

1.3 Supports de données

Le concept d’union de la Meta-Data, implique logiquement aussi celui du support. Les formulaires vierges (blank forms – 2 §. 6) doivent aussi être contrôlés. Dans la mesure où le support détermine aussi une partie du signifiant (c’est-à-dire des informations qualifiantes), ce support fait aussi l’objet d’un cycle contrôlé. Même si cette notion est plus propre à être interprétée dans le sens d’un support papier, il n’en demeure pas moins qu’elle est applicable aussi au format électronique (gestion des formulaires de saisie), mais aussi aux matrices Excel types (matrices de calcul “Templates” souvent présentes dans les laboratoires). PIC/S envisage ce point principalement sous l’aspect des formulaires papier(3§8 et suivants). Il est à noter que bien souvent ces formulaires existent en format électronique dans le but d’être remplis manuellement ou électroniquement.

1.4 Cycle de vie des données

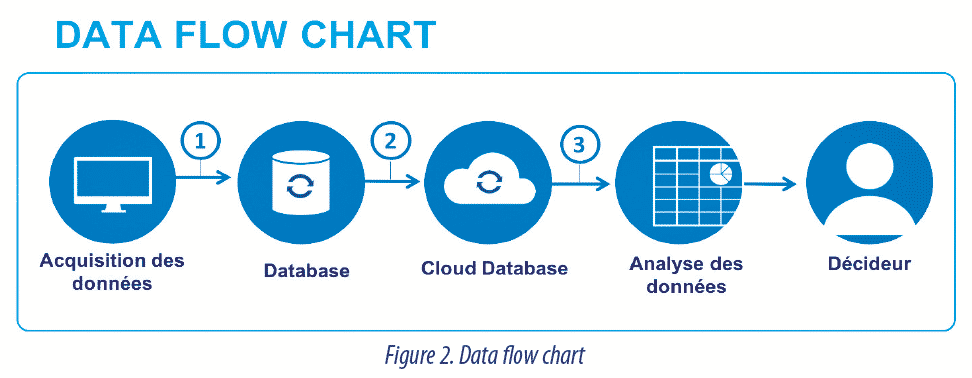

Il convient aussi de noter l’apparition du concept de Data Life Cycle (Cycle de vie des données) qui a pour but de prendre en compte la totalité de la vie de la donnée depuis sa génération, son contrôle, son stockage, ses éventuelles transformations, son utilisation et son archivage (4 § 6.6 ou 3 § 13.7). Cette notion de cycle de vie de la donnée est à opposer à une notion relativement ancienne du cycle de vie applicatif. C’est là où on voit le caractère novateur du concept d’intégrité des données. La donnée surtout informatique existe par elle-même et non plus uniquement au travers de l’applicatif ou des applicatifs qui l’ont généré et la manipule. Du coup, on comprend mieux que la donnée qui auparavant était étudiée et envisagée uniquement au travers de l’applicatif, lequel devait être validé, se détache complètement des “systèmes” pour devenir Information. L’extension de l’informatique dans l’entreprise favorise de plus en plus ces transferts de données. Telle donnée, générée par un équipement de production ou de contrôle, peut très bien être transportée au travers de plusieurs applicatifs et participer au final à une prise de décision en rapport avec la sécurité du patient ou la qualité du produit (voir exemple Fig 2).

Le concept de cycle de vie de la donnée, permet de bien comprendre qu’il est nécessaire de garantir que la portée sémantique de la donnée qui sera utilisée pour prendre une décision en relation avec la santé du patient et la qualité du produit, ne trahit pas la valeur initiale qui a été générée par l’équipement d’origine. Il incombe donc de pouvoir garantir et démontrer que les transformations successives de la donnée n’en altèrent pas la valeur et que la donnée d’origine (donnée source ou Raw Data) est toujours accessible si nécessaire.

1.5 Migration de données, transfert de données, interfaces

Une donnée, dans sa compréhension la plus large (voir ci-dessus le concept de MétaData, Data, Audit Trail), peut être transférée (elle passe d’une solution informatique à une autre), mutée (elle est réimplantée dans un nouveau système Informatique par l’intermédiaire de ce que l’on appelle une reprise de données), voire peut être regénérée si sa structure de stockage devient obsolète ou ne peut pas être conservée. Cette opération doit bien évidemment faire l’objet d’une démarche appropriée pour vérifier et documenter la conservation de la qualité de la donnée. Les transferts de données sont compris pour PIC/S comme un élément du cycle de vie de la donnée(3 § 5.12).

Pour le MHRA(4 § 6.8) c’est une démarche à part entière qui doit comporter une “rationnelle”, une validation robuste ayant pour but de démontrer l’intégrité des données. De façon très intéressante, le texte du MHRA insiste sur les risques liés à ce genre d’opération et évoque les erreurs fréquentes dans ce domaine.

1.6 Concepts existants

On retrouve par ailleurs, sans pour autant que cela les minimise, des concepts déjà largement évoqués dans les textes européens et/ou américains.

- La signature électronique(2 § III – 11 ; 3 § 9.3 ; 4 § 6.14 ; 5 § 14), l’audit trail(2 § III – 1 c ; 3 § 9.4 ; 4 § 6.13 ; 5 § 9) ; dans tous les cas de modifications et d’action sur les données ;

- Les différentes formes de sécurité comprenant l’accès aux données et aux systèmes (voir ci-après plus en détail sur la sécurité)(2 § III 1.e et 1.f ; 3 § 9.3 ;4 § 6.16, 6.17,6.18 ; 5 § 12 et suivants).

- La cartographie/inventaire avec des analyses de risque pour identifier et maîtriser ses systèmes et ses données(3 § 9.21 ;4 § 3.4 ; 5 § 4.3), les flux de données, les passages et les changements d’un applicatif à l’heure, les secteurs à risque avec une évaluation de la nature et de la portée du risque.

- Les revues périodiques et la gestion des incidents avec des actions correctives et préventives si nécessaires (3 § 9.2.1 – 4 ; 4 §6.15 ; 5 § 11, 13).

- La temporalité des données et l’instantanéité des créations (relation évènements-données) (3 § 8.4 ; 4 § 5.1).

2. Grands principes d’une mise en place dans son système qualité de l’intégrité des données

On le voit donc, par-delà les éléments déjà existants et largement documentés dans les textes comme les EU-GMP (voir ci-dessus), des nouveaux concepts font jour, auxquels il est nécessaire d’accorder un peu plus d’attention et de les considérer comme des points de vigilance particuliers en vue de mettre en place une vraie politique de gestion de l’intégrité des données dans une entreprise.

2.1 Policy

Le premier point qui attire l’attention et qui se révèle être vraiment une nouveauté est la prise en compte de la problématique de l’intégrité des données au plus haut niveau de l’organisation. Il est nécessaire de disposer d’une “policy” ou d’une procédure de politique générale qui comprendra au moins les points suivants :

- La définition de la Data Integrity telle qu’elle est comprise dans l’entreprise ainsi que son périmètre. Sans omettre les données qui ne font pas l’objet d’un stockage ou d’une gestion électronique ou éventuellement d’un stockage hybride. Il ne s’agit pas ici de refaire les textes réglementaires mais bien plutôt de livrer une interprétation interne à destination de l’ensemble du personnel.

- Les moyens humains mis en place en termes d’organisation pour gérer la Data Integrity. Par exemple : y a-t-il un Data Management Committee ? ou un responsable général des données ? Les principes organisationnels et humains de maîtrise de l’intégrité des données ainsi que les notions de responsabilités individuelles face au challenge de la préservation des données et ceci dans l’idée de rentrer dans une organisation “open” similaire aux préconisations du PIC/S.

- La mise en place des solutions de maîtrise comme les principes de cartographies, les conditions générales d’évaluation du risque ainsi que les mesures appropriées pour garantir le maintien de l’intégrité de ces données. Il s’agit de définir les conditions selon lesquelles des données seront exploitées dans l’organisation, comment elles sont cartographiées, comment une analyse de risques est effectuée dans leur cycle de vie et les mesures prises pour garantir leur pérennité.

- La sécurité doit être abordée de la façon la plus large qu’il s’agisse de sécurité physique, de sécurité logique ou de continuité (voir ces concepts plus loin). Il importe aussi de tenir compte dans la sécurité logique de l’importance de la prise en compte de la signature électronique. De présenter aussi les moyens pour s’assurer que l’ensemble des acteurs accordent à la signature électronique une importance similaire à la signature manuelle comme le demandent les textes. C’est-à-dire de prévoir que le personnel en mesure d’utiliser une signature électronique en a été informé et qu’il est conscient de son équivalence avec une signature manuelle.

- Les moyens organisationnels pour effectuer les revues de contrôle, le tracking des incidents et le traitement des actions correctives et préventives éventuelles.

- Les conditions liées aux modifications, mutations, reprises de données sont bien définies. Qu’elles permettent de disposer des moyens nécessaires pour s’assurer que ces différentes opérations sont bien réalisées dans un cadre présentant une rationnelle. Que ces moyen assurent de façon robuste que les transferts ou modifications de ces données ont fait l’objet d’une démarche de validation satisfaisante et n’altèrent pas la valeur sémantique initiale.

- Les contraintes spécifiques liées à la mise en place de solutions informatisées et notamment, les exigences à respecter lors de la mise en place de nouvelles solutions, ceci dans le but de pouvoir garantir le maintien de l’intégrité des données.

Cette “policy” doit être approuvée au plus haut niveau et faire l’objet d’un large consensus dans l’organisation. Elle doit faire l’objet d’une diffusion et d’une formation générale auprès du personnel. Cette formation doit être tracée.

2.2 Cartographie / Analyse de risques

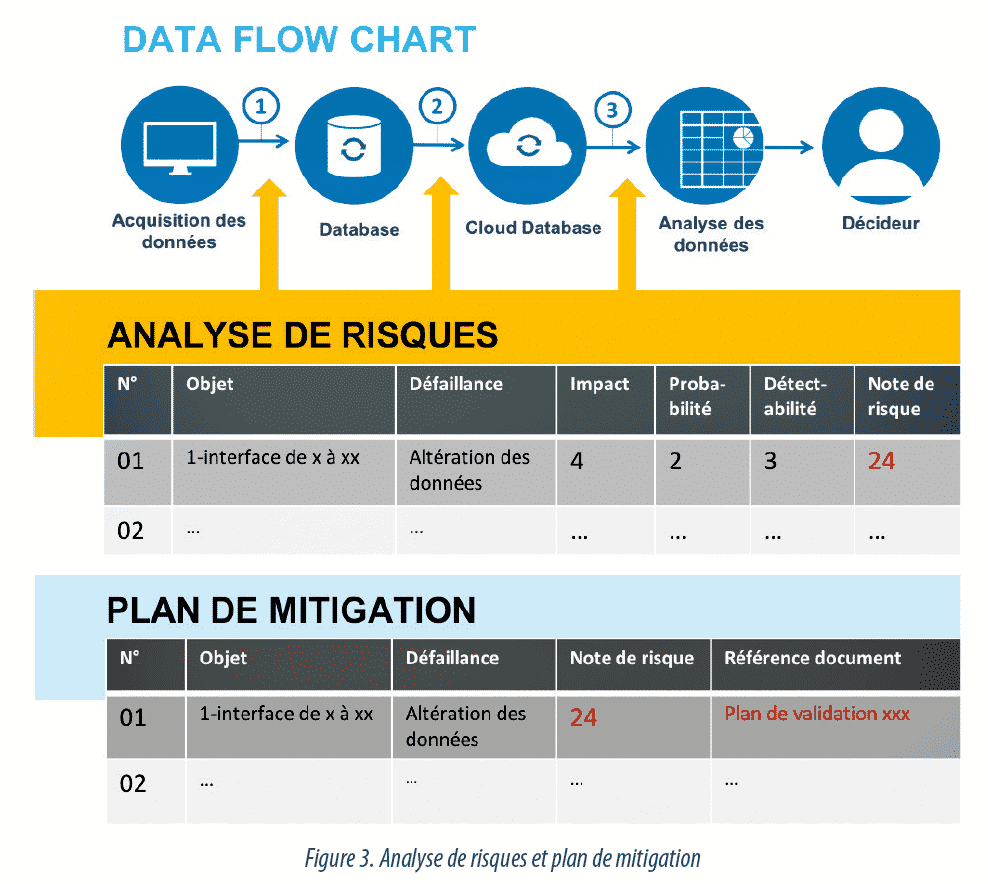

La cartographie est une exigence présente depuis longtemps dans les EU-GMP et qui a parfois été confondue avec les VMP (Validation Master Plan) b(5 § 4.3). Ces deux documents peuvent être réalisés de concert. Il est toutefois intéressant de traiter à part la cartographie dans le but de la faire évoluer en temps réel et non plus au fur et à mesure de la mise en place de solution. La cartographie, qui par le passé, avait plutôt tendance à présenter une vision orientée “systèmes” doit prendre en compte les données sous la forme Data Flow chart.

Un exemple de Data Flow Chart est présenté (fig. 3).

Un Data Flow Chart doit permettre d’identifier :

- Les éléments qui contribuent à la génération des données.

- Les éléments de stockage et de protection des données sources ainsi que les éléments permettant de procéder à une restitution de façon rapide et compréhensible.

- Les lieux de transfert de données et les démarches entreprises pour s’assurer qu’il ne s’effectue pas une altération de la signification des données.

- Sur les points identifiés comme à risque les actions mises en place pour contrôler ou mitiger ce risque.

- Le cycle de vie complet depuis la génération jusqu’à l’archivage / ou la suppression le cas échéant.

L’analyse de risque doit aussi identifier, en fonction de la sensibilité des données concernées, la périodicité des revues.

2.3 Sécurité

Les principes de la sécurité(5 § 12), doivent faire l’objet de procédures ad hoc et reposent sur trois grands volets.

- La sécurité physique.

Il s’agit de l’ensemble des moyens et des mesures qui permettent de s’assurer qu’une altération des données ne pourra être effectuée par des moyens physiques. Si les grands systèmes de données sont en général bien protégés, les altérations ou les risques peuvent souvent apparaître par l’intermédiaire de solutions isolées physiquement (ex. : solution “stand alone” qui contrôle un équipement et où on peut accéder facilement à la machine), de périphériques aux réseaux (armoires techniques de réseau par exemple), voire aux éléments physiques de stockage. Dans la théorie sont pris en compte les problématiques liées à la qualité du courant électrique, les risques d’incendie, d’inondations, les risques liés aux animaux, aux températures, aux accès physiques, etc. Dans le cadre de l’intégrité des données, il convient aussi de prendre en compte la protection physique des données sur format papier et de protéger l’accès à ces données.

- La sécurité logique.

Il s’agit de l’ensemble des mesures qui permettent de s’assurer que l’accès aux systèmes est effectué uniquement par des personnes dûment autorisées et sous contrôle d’un enregistrement strict et d’une traçabilité complète des accès. Les accès aux systèmes et/ou aux données ne peuvent être anonymes et sont forcément individualisés et autorisés. L’autorisation est effectuée sur la base d’un profil documenté et suite à une traçabilité de formation qui permet de garantir que les acteurs sont formés à l’importance de leurs actions. Les intervenants en position d’administrateurs de systèmes ou de données doivent être formés et la formation doit être tracée. A ce propos, il est intéressant de noter la position du document du PIC/S(3 § 9.3) sur les administrateurs. Celui-ci souligne la sensibilité de cette fonction et demande que l’administrateur soit bien identifié comme une personne qui n’est pas impliqué opérationnellement dans l’usage du système concerné. Dans les bonnes pratiques, un administrateur doit disposer d’un compte d’administration spécialisé pour effectuer les tâches d’administration et qui ne soit pas confondu avec ses tâches autres, et la connexion en qualité d’administrateur doit être tracée et permettre d’identifier nommément la personne connectée. La disponibilité des informations relatives à la sécurité logique et notamment l’identification rapide et aisée des personnes possédant des droits sensibles au regard de l’intégrité des données (modification de statut par exemple), doit être assurée de façon rapide et lisible à l’attention de tout auditeur ou inspecteur.

- La continuité.

Il s’agit de l’ensemble des mesures qui permettent d’envisager les opérations préventives ou correctives à exécuter en cas de sinistre ou d’évènements et qui garantissent que quelque soient les évènements, il n’y aura pas de perte de données. Au rang de ces opérations on trouve les conditions relatives aux opérations de backup, ainsi que les opérations de restauration qui peuvent aussi altérer la donnée de façon non réversible. Les mesures intégrées dans les plans de continuité d’activité et notamment les DRP (Disaster Recovery Plan – Plan de retour suite à un sinistre/plan de secours). Ce sujet, très vaste par ailleurs, est un sujet d’entreprise qui se décline en de multiples volets et permet de garantir en dernier ressort la sécurité des données.

2.4 Comportement

On a vu l’importance qui est accordée au sein des différents textes (et surtout le PIC/S et le document du MHRA) sur la gouvernance à tous les niveaux, et particulièrement sur le comportement dans la gestion de l’intégrité des données. On imagine toute la difficulté qu’il y a dans tout ce qui touche au comportement. Le PIC/S insiste sur ce sujet et y consacre une section entière(§ 6). La sensibilisation des personnels, leur protection vis-à-vis de “pressions” qui pourraient intervenir pour les pousser à falsifier des données, est un point nécessaire à maîtriser. Le PIC/S déclare “… An understanding of how behaviour influences the incentive to amend, delete or falsify Data and the effectiveness of procedural controls designed to ensure Data integrity…“.

Il importe donc de :

- Considérer la mise en place de la Data Integrity au sein d’une organisation comme un programme directement sponsorisé par les plus hautes responsabilités de l’entreprise.

- Organiser les actions pour que les collaborateurs soient des participants actifs à l’intégrité des données.

- Mettre en place les actions de formations adéquates pour les former sur l’importance et la fragilité des données aussi bien que sur des concepts clés, comme la signature électronique, la traçabilité des opérations sur les données, les revues d’audit trail.

- Ne pas oublier d’établir des moyens de revue, de contrôle et de correction pour se réadapter.

Les inspecteurs et auditeurs attendent clairement que cette volonté soit l’expression d’une culture d’entreprise permettant de garantir que des mesures frauduleuses d’altération des données ne puissent pas intervenir.

Conclusion

L’intégrité des données est un processus important et qui demande une réadaptation de son système documentaire et de son système qualité en profondeur.

Les vingt dernières années ont très largement débattu des sujets relatifs à la validation des systèmes informatisés. Il est vrai que dans l’expression système d’information, la balance penchait beaucoup plus en faveur du système que de l’information. C’est la première grande vertu de cette démarche que d’avoir repositionné la donnée au centre du débat, en soulignant son importance mais aussi sa fragilité et ses menaces.

Il est important de comprendre alors que ce sujet revêt une importance toute particulière à la lumière des actualités et notamment des actes délictueux qui ont été accomplis. Même si dans la plus grande majorité des cas, les risques encourus par la donnée, ne le sont pas pour ces raisons, le sujet est particulièrement sensible.

La clé de la maîtrise de la Data Integrity semble donc reposer sur trois grands piliers :

- Comportement et gouvernance : une affaire d’entreprise à tous les échelons, qui reflète une culture qualité.

- La maîtrise de son territoire de données au travers des Data Flow Chart et des analyses de risques sur les données en intégrant la vision “élargie” de la donnée, c’est-à-dire signifié, Métadonnées et Audit Trail

- Le respect de la réglementation notamment au niveau de tout ce qui concerne la sécurité sous tous ses aspects ainsi que la validation.

Partager l’article